Kubernetes è ormai uno standard consolidato per l'esecuzione di applicazioni containerizzate in ambienti di produzione, ma la sua vera forza emerge quando si usano a pieno le feature messe a disposizione da tale orchestratore. Kubernetes, infatti, abilita automazione, scalabilità e affidabilità lungo tutto il ciclo di vita del software.

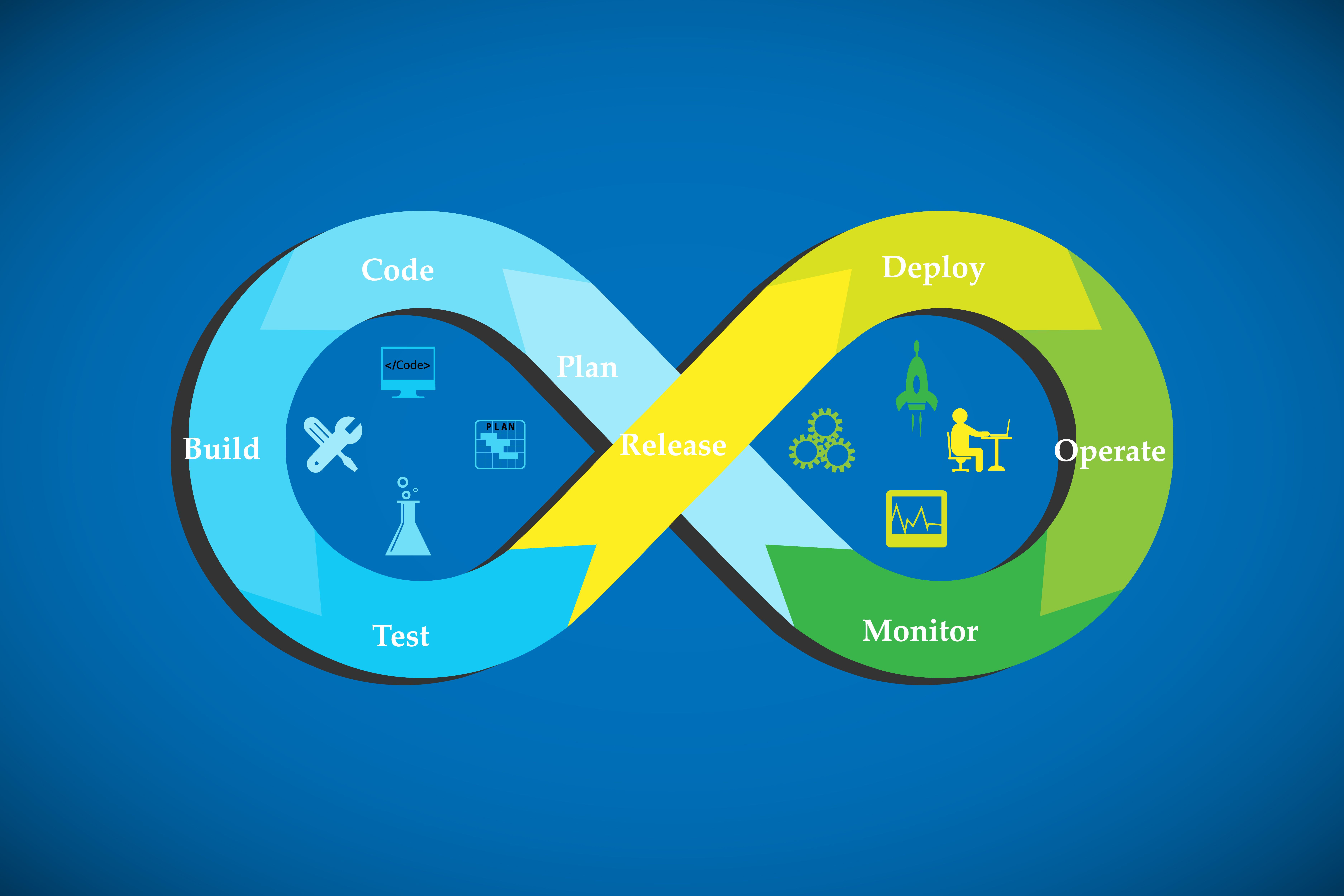

Come Kubernetes supporta il DevOps?

La metodologia DevOps punta a ridurre il tempo tra sviluppo e rilascio, a favorire la collaborazione, l’automazione e i feedback rapidi. Kubernetes abilita questi principi grazie ad alcune caratteristiche che lo rendono ideale per ambienti di sviluppo moderni consistenti e ripetibili.

Con Kubernetes, le applicazioni vengono descritte tramite i manifest YAML che definiscono lo stato desiderato: quali container utilizzare, quante repliche attivare, quali risorse allocare. Questi file funzionano allo stesso modo in sviluppo, staging e produzione. Il classico problema del "funzionava in sviluppo ma non in produzione" non esiste più! La configurazione diventa codice versionabile e riproducibile.

Gestione dichiarativa

Invece di elencare operazioni da eseguire in sequenza, con Kubernetes si dichiara lo stato finale desiderato. Il sistema si occupa di raggiungerlo, mantenerlo e correggerlo automaticamente in caso di anomalie. Se un pod si interrompe, viene riavviato. Se un nodo diventa indisponibile, i carichi di lavoro vengono distribuiti in base ad opportune logiche relative a capacità totale del cluster e richiesta computazionale o di memoria dei workload applicativi Questo approccio riduce drasticamente gli interventi manuali.

Scalabilità automatica

Kubernetes offre meccanismi nativi per adattare le risorse al carico reale. Gli Horizontal Pod Autoscaler, ad esempio, possono aumentare o ridurre il numero di repliche in base a metriche come l'utilizzo di CPU, la latenza delle richieste o i parametri applicativi personalizzati. Il risultato è un'infrastruttura che si adatta automaticamente alle esigenze.

Il VerticalPodAutoscaler, invece, aggiorna automaticamente una risorsa di gestione dei workload (come un Deployment o uno StatefulSet), con l’obiettivo di adeguare in modo automatico le richieste e i limiti delle risorse infrastrutturali all’utilizzo reale.

Rilasci sicuri e reversibili

Le strategie di deployment native (rolling update, blue-green, canary) permettono di aggiornare le applicazioni senza downtime e di verificare progressivamente che ogni nuova versione funzioni correttamente. In caso di problemi, il rollback è immediato e automatizzabile. Questa sicurezza consente di rilasciare con maggiore frequenza e ridurre il rischio associato a ogni singolo cambiamento.

Ecosistema integrato

Kubernetes si inserisce in un ecosistema maturo di strumenti cloud-native (Helm, Argo CD, Tekton, Prometheus, Grafana) che coprono l'intero ciclo DevOps. Questo permette ai team di costruire pipeline complete senza dover integrare tecnologie eterogenee.

Pipeline CI/CD con Kubernetes: strumenti e best practice

Una pipeline CI/CD che utilizza Kubernetes come target di deployment segue generalmente un flusso articolato in fasi distinte ma interconnesse.

Continuous Integration (CI)

Ogni volta che viene effettuato un commit su un repository Git, si attiva automaticamente una pipeline che esegue una serie di operazioni standardizzate:

- compilazione del codice sorgente

- esecuzione di test automatici (unit test, integration test)

- analisi statica del codice e controlli di sicurezza

- build dell'immagine container

- pubblicazione dell'immagine su un registry (Docker Hub, Harbor, Amazon ECR)

Questa fase garantisce che ogni modifica sia stata validata prima di proseguire nel flusso. Se i test falliscono, il processo si interrompe e il problema viene segnalato immediatamente al team.

Continuous Delivery/Deployment (CD)

Una volta che l'immagine è stata creata e testata, la pipeline aggiorna la configurazione di deployment di Kubernetes (manifest YAML o chart Helm) puntando alla nuova versione e applica il cambiamento al cluster. Questo passaggio può essere:

- semi-automatico: richiede un'approvazione manuale, ma il rilascio viene gestito dalla pipeline

- completamente automatico: ogni commit che supera i test viene rilasciato in produzione (tipico in contesti con forte copertura di test o su ambienti non critici)

Verifica post-deployment

Dopo il rilascio, la pipeline esegue controlli automatici per verificare che l'applicazione funzioni correttamente: health check, smoke test, test end-to-end. Se vengono rilevati problemi, la pipeline può interrompere il rollout o eseguire un rollback automatico alla versione precedente.

Tra gli strumenti più utilizzati per implementare pipeline CI/CD su Kubernetes figurano:

- Helm: permette di impacchettare le configurazioni Kubernetes come chart versionati, semplificando installazione, aggiornamento e condivisione

- Kustomize: consente di gestire varianti dei manifest per ambienti diversi senza duplicare file

- Tekton e Argo Workflows: soluzioni cloud-native per definire pipeline CI/CD direttamente all'interno di Kubernetes

Le best practice consolidate per implementare pipeline efficaci includono:

- Separazione tra build e deploy. La fase di creazione delle immagini container deve essere distinta da quella di rilascio sul cluster, per aumentare controllo e sicurezza.

- Parametrizzazione delle configurazioni. Utilizzare Helm values o Kustomize per gestire le differenze tra ambienti (URL, risorse, replica count) senza modificare il codice base.

- Controlli di sicurezza integrati. Implementare scansione delle immagini, analisi delle vulnerabilità e policy admission controller per bloccare configurazioni non conformi prima che raggiungano la produzione.

Un esempio pratico: deploy automatizzato con GitOps

GitOps rappresenta un'evoluzione naturale delle pratiche DevOps applicate a Kubernetes. In un'architettura GitOps tipica applicata a Kubernetes, il flusso operativo si articola come segue.

Esistono uno o più repository Git che contengono i manifest Kubernetes (o chart Helm) che descrivono lo stato desiderato del cluster. Uno strumento GitOps specializzato come Argo CD o Flux monitora continuamente questi repository. Quando viene rilevata una modifica, la applica automaticamente al cluster.

Mettiamo il caso di uno sviluppatore che effettui un commit che modifica il codice applicativo sul repository principale. La pipeline CI costruisce l'immagine Docker, esegue i test e la pubblica sul registry. La pipeline aggiorna automaticamente il repository GitOps, modificando il tag dell'immagine nel manifest di deployment o nel file values.yaml di Helm. Argo CD rileva il cambiamento nel repository GitOps e applica l'aggiornamento al cluster Kubernetes. L'interfaccia di Argo CD mostra lo stato di sincronizzazione in tempo reale, confermando quando cluster e repository sono allineati.

Ogni modifica all'infrastruttura e alle applicazioni è rappresentata da un commit Git con autore, timestamp e descrizione. Questo crea un audit trail completo, fondamentale per compliance, debugging e comprensione dell'evoluzione del sistema. Per tornare a una versione precedente è sufficiente effettuare un revert o un checkout su un commit precedente nel repository GitOps. Lo strumento di sincronizzazione si occuperà automaticamente di adeguare il cluster. Nessun comando urgente in produzione, nessun rischio di errori manuali.

Inoltre, se qualcuno modifica manualmente il cluster (situazione non infrequente in contesti di troubleshooting), lo strumento GitOps rileva la deriva dallo stato dichiarato e può ripristinare automaticamente la configurazione corretta. Questo elimina le "configurazioni fantasma" che si accumulano nel tempo e di cui nessuno conosce più l'origine.

In caso di perdita totale del cluster, inoltre, è possibile ricrearlo completamente partendo dai repository Git.

Monitoraggio continuo con Prometheus e Grafana

L'automazione di build e deployment rappresenta solo metà dell'equazione DevOps. L'altra metà fondamentale è l'osservabilità: la capacità di comprendere cosa accade alle applicazioni in produzione. Qui entrano in gioco Prometheus e Grafana, due strumenti diventati standard de facto per il monitoring in ambienti cloud-native.

Prometheus è un sistema di monitoring e alerting progettato specificamente per architetture dinamiche come quelle basate su Kubernetes. Utilizza un modello "pull": interroga periodicamente gli endpoint esposti dai componenti del cluster e dalle applicazioni raccogliendo metriche in formato time-series. Non richiede che le applicazioni "inviino" dati attivamente, semplificando l'integrazione.

Grafana, invece, è la piattaforma di visualizzazione e analytics che trasforma i dati raccolti da Prometheus in dashboard comprensibili. Permette di creare visualizzazioni personalizzate, combinare metriche da fonti diverse, configurare alert e condividere dashboard tra team.

In un cluster Kubernetes monitorato con Prometheus, è possibile raccogliere metriche a diversi livelli:

- Metriche di infrastruttura: stato dei nodi, utilizzo di CPU e memoria, spazio disco disponibile, stato dei pod (running, pending, failed).

- Metriche di rete: latenza, throughput, error rate delle comunicazioni tra servizi.

- Metriche applicative: metriche custom esposte dalle applicazioni tramite endpoint /metrics, come numero di richieste elaborate, durata delle transazioni, code size.

Queste metriche vengono poi visualizzate in Grafana attraverso dashboard organizzate per finalità:

- Salute del cluster: panoramica dello stato dei nodi, pod non schedulabili, namespace che consumano più risorse, eventi critici.

- Performance dei servizi: applicazione dei "golden signals" (latency, traffic, errors, saturation) per valutare la salute di ciascun microservizio.

- Impatto dei rilasci: confronto delle metriche prima e dopo un deployment per identificare rapidamente regressioni o miglioramenti

In scenari avanzati, è possibile anche automatizzare azioni correttive: rollback automatici, scaling preventivo, o blocco di ulteriori deployment fino alla risoluzione del problema.

Quel che è certo è che l’ecosistema Kubernetes-GitOps-Prometheus-Grafana crea un ambiente in cui sviluppo, rilascio, osservabilità e miglioramento continuo sono interconnessi in un ciclo virtuoso che li rende parte diun sistema volto naturalmente alla stabilità, all'efficienza e all'evoluzione costante: quello DevOps!

Se desideri utilizzare Kubernetes nella tua azienda, sperimentare i vantaggi dell’approccio DevOps o se hai bisogno di supporto per ottimizzare la tua infrastruttura rivolgiti a noi!